ブログの読者さんに半導体関連の話に詳しい方がいらっしゃるので、言及するのを躊躇ったのだが、まあ、間違っていたら指摘して下さいってことで。

本日のネタはHBM(High Bandwidth Memory)である。

韓国半導体製造装置メーカーが中国企業に製品供給、韓国ネットは技術流出を懸念

2025年6月24日(火) 10時0分

2025年6月23日、韓国メディア・ソウル経済は「韓国の半導体製造装置メーカー、ハンミ半導体が中国の半導体大手にTCボンダーを納品したことが確認された」と伝えた。

レコードチャイナより

詳しくかつ分かり易く説明するのは難しいので、ザックリした説明だが、要はAI

技術のキモを握る「早い」メモリである。

主戦場になりかねない

広帯域メモリ

えぇ?ザックリ過ぎる?

説明が難しいんだよね、コレ。

PCに搭載されるメモリというのは、PCの速度を左右する重要なパーツなのだけれど、一般の方というのは余り気にしない話なんだと思う。これもザックリの説明で申し訳ないんだけど、CPUが計算をやる際に、大量の情報を扱う必要があって、そのデータをCPU内に溜められないからメモリや外部記憶媒体に溜めることになる。でも、CPUとの通信速度が高くないとCPUの処理速度の足を引っ張ることになるので、出来るだけ通信速度を早くしたい。

そのために搭載されるのがメモリというヤツで、最近の規格はDDR5とかDDR5とかがある。HBMはその次の世代だと言われてきたメモリなんだよね。なお、DDR6、DDR7が発表されているので、DDR5がDDR SDRAM規格の最後のメモリというわけではないようだが。

DDR SDRAMの規格が随分長いこと使われてきて、その次に来るのがHBMってことらしい。

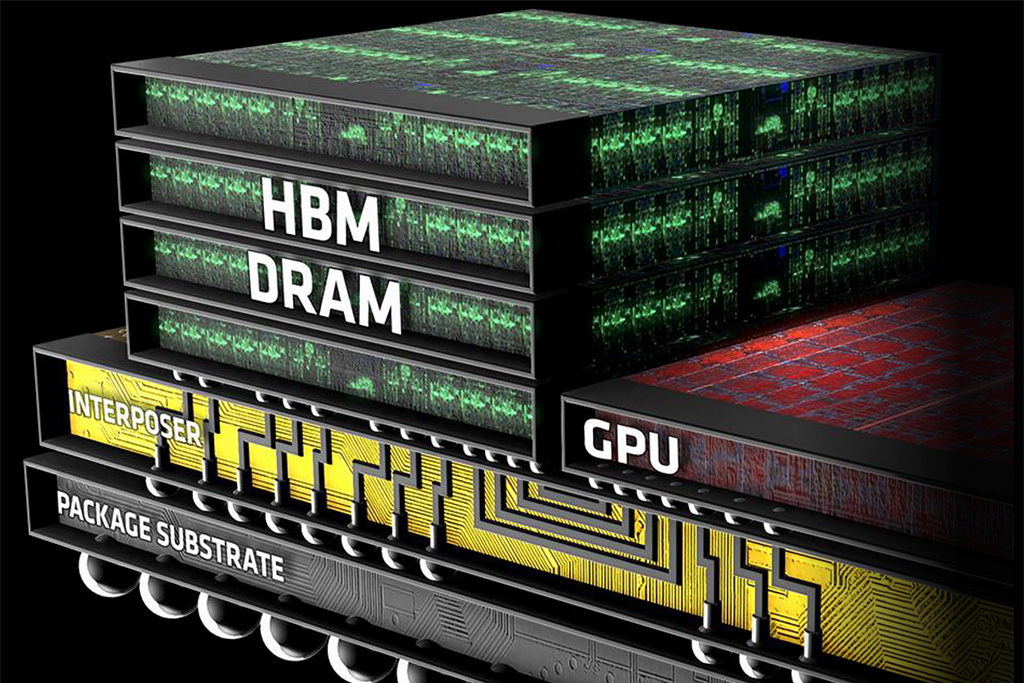

で、DDR SDRMとHBMとの違いは、これも分かり易くザックリした説明をすると、水道管の太さを太くするっていう話。

もうちょっと詳しい説明はこの辺りの記事を読むと分かり易いかも知れない。

TSV技術で積層するGDDR5後継メモリ「HBM」の詳細

2014/5/1 06:00

高性能プロセッサではメモリ帯域がボトルネックとなり、次世代の高性能DRAM「HBM(High Bandwidth Memory)」へと急送に傾きつつある。HBMは、JEDEC(半導体の標準化団体)が規格化したメモリで、GDDR5の後継の広帯域メモリとなる。2014年後半には、まずSK hynixから量産が始まり、2015年には最初の搭載製品が登場すると見られている。高性能のビデオカードカード、HPC(High Performance Computing)向けのGPUやスループットプロセッサのメモリ、サーバーCPUのキャッシュ、GPUコア内蔵CPUのメモリ、ネットワークプロセッサ向けメモリなどの用途が想定されている。

PC Watchより

興味があればどうぞ。

こんな感じの構成がグラフィックボードに採用されがちなんだけど、現状はHBMはまだ高価なんだよね。だからこそ、グラフィックボードがたらと電力を消費するのである。

コア技術の流出

HBMはAI技術には必須だと言われていて、GPUを利用した大量の情報を処理するやり方にはHBMは利用価値が高い。

そして、その技術で大儲けをしているのが韓国なんだが、韓国から技術流出があるのでは?と、最近騒ぎになっているんだよね。

複数の半導体業界関係者が「ハンミ半導体が昨年、中国メーカーに複数のTCボンダーを納品した」と証言したという。今年は追加発注がなく、現在も装備のテスト中だと伝えられる。TCボンダーはHBM(High Bandwidth Memory)製造に必須の装備。ただ、ハンミ半導体関係者は「顧客企業に関する情報は明らかにできない」とコメントしているという。

ハンミ半導体が中国メーカーに販路を広げたのは、SKハイニックスのベンダー多角化を受けての対抗策だとみられている。SKハイニックスは昨年6月、ハンファセミテック(旧社名:ハンファ精密機械)からTCボンダー2台を購入しており、今年はハンミ半導体よりハンファセミテックからより多くの供給を受けているという。昨年のTCボンダーの売上高のほとんどをSKハイニックスに依存していたハンミ半導体は今年4月、SKハイニックスに派遣していたエンジニアを撤退させ、強い不満を示した。

記事は「ハンミ半導体が中国に大量納品したわけではないが、韓国の特許技術などを活用し、技術を複製されるのではという懸念がある」と指摘している。

レコードチャイナより

で、熾烈な半導体開発競争をやっている最中に、製造措置が輸出されちゃったということのようだ。

中国、昨年米国を抜いて登録1位 被引用回数も中国が圧倒 韓、HBMシェア90%だが R&Dでは事実上中国に逆転

2025-02-12 18:11:09

メモリー半導体分野の独歩的な先進国だった韓国を中国が追い上げてきた。 韓中Dラム技術力の格差は急激に縮まっており、中国のNAND型フラッシュの製造能力は韓国とほぼ同じ水準に達している。 何よりも人工知能(AI)時代の必須部品である高帯域幅メモリー(HBM)技術は事実上、中国が韓国を逆転した。

毎日経済より

割と接戦になりつつある開発競争が行われる状況で、こんなニュースも。

SKハイニックスの協力会社の元社員、HBM技術の流出を図り逮捕

入力 : 2025-05-25 17:58:31 修正 : 2025-05-25 20:12:05

SKハイニックスの協力会社の元社員が、人工知能(AI)半導体の核心技術である高帯域幅メモリー(HBM)パッケージング技術を中国に流出させようとしたが、仁川空港でソウル警察庁の産業技術安保捜査隊に緊急逮捕された。 彼は今年初めに退社し、外部に流出する目的でHBMパッケージング技術を確保したことが分かった。

25日、最高検察庁によると、国家核心技術を流出した産業技術保護法違反の起訴件数は、2021年14件、2022年14件、2023年19件、2024年26件と、持続的に増加している。

毎日経済より

情報戦争も激しく行われている模様。

次世代技術は

なお、HBMのその次の技術に関する研究も続けられていて、そこには日本のメーカーの名前もある。

キオクシア、次世代メモリー開発 データ転送速度3割増

2025年2月20日 12:21

キオクシアホールディングスは20日、次世代のNAND型フラッシュメモリーを開発したと発表した。性能を示す積層数は332層と従来の218層から増やした。データ転送速度も33%高めた。データを読み込む際の電力効率も改善し、人工知能(AI)向けデータセンターなどで引き合いを見込む。

日本経済新聞より

この次世代NAND型フラッシュメモリは、HBMだけではなく更にその次の技術の研究が行われていて、我が国の企業も頑張っていることは頑張っているのだけれど、資金力の差は圧倒的である。

支那にしても韓国にしてもほぼ国策企業なので、資金力が違う。それでも日本企業も色々努力はしているようだが。

勿論アメリカ企業も開発努力をしていて、日本もそこに参加して開発している部分もあるのだけれど、難航しているようだね。だが、ここを握るかどうかが今後の経済にも大きな影響が出てくるわけで、その点を踏まえても、覚悟を決めて研究開発して欲しいところ。

韓国は支那に技術を盗まれてしまうと、HBMの製造でも利益が得られなくなっていよいよ危なくなるだけに、ここも熾烈な争いが行われているようだけれど。

頂いたコメント

内容の要約

本文をだらだらと書いてしまったけれども、簡単に要約しておこう。

- HBMのような基幹技術は経済・産業・安全保障に直結する重要分野。

- 技術流出の防止と、次世代技術の主導権を握ることが、各国の死活課題。

- 日本も資金面では不利ながら、覚悟を持って開発に挑んでほしい。

韓国から支那にTCボンダーが供給されちゃったけど、危なくないの?という話で纏めたのがこの3点で、これに対して詳しい解説をいただいたので、本文に昇華しておきたいと思った次第。

韓国製TCボンダーの購入で中国がHBM技術に追いつけるか?

結論:困難

理由①:HBMにおけるTCボンダーの役割

- TCボンダー(チップ間接続装置)はHBM(High Bandwidth Memory)の基幹技術の一部。

- しかし、HBMの製造技術全体のごく一部にすぎず、装置単体を輸入しても意味は薄い。

- 実際には、HBM製造プロセス全体と一体化した技術開発が必要。

理由②:EUVリソグラフィ(極端紫外線露光)の不可避性

- 現在、主要メーカー(Samsung, SK Hynix, Micron)はすべてEUVを導入済み。

- 中国は、米国の輸出規制によりASML製EUV装置を正規には入手不可。

- EUV非使用での微細化にも限界があり、HBMレベルの製品には大きな障壁。

参考:

下記記事の図9参照(微細化の工程比較)

https://eetimes.itmedia.co.jp/ee/spv/2405/07/news034_4.html

- 特に注目すべきは最下行(各社のEUV使用レイヤー数)。

- マイクロンも近年EUVを導入しており、もはやEUVなしでの参入は現実味がない。

備考:EUV装置のハードル

- ASML製EUV装置は1台300~500億円の超高額。

- 裏ルートでの密輸も現実的ではない。

ちなみに:中国にも一定の成果はある

- ArFエキシマレーザー(193nm)を使って、7nmクラスのチップを根性で量産した実績はある。

- しかし、それでも工程数・コストともにEUVに劣る。

- HBMはロジック並みの微細化を求められ、コスト制約も厳しいため、EUV無しでの短期的追従は困難。

- 少なくとも今後2~3年は中国の追い上げは厳しい。

とまあこんな感じなので、直ぐ追いつくというのは難しそう。

コメント

超遅レスですが宿題っぽかった(^^; ので、識者ぶりっ子恥ずかしいすがウンチク披露。

業界から離れて15年以上のBOOKです。単なるシッタカです。ごめんなさいm(_ _)m

まずメインのトピ命題

「韓国製 TCボンダー の購入で志那はHBM技術に追従、追い越しして来るか?」

結論:困難でしょう

理由1:TCボンダー使う配線接続はHBMの基幹技術の一つです。しかしコレHBMチップ製造と一体の技術なのでTCボンダーだけ買って来ても

新たに技術開発必要です。

理由2:もう一つの基幹技術

「微細化」が もうHBM全メーカー(SK,サムスン,マイクロン)

が(極端紫外線) EUV露光装置を使った微細化に突入してて、志那はEUV使えない。

https://eetimes.itmedia.co.jp/ee/spv/2405/07/news034_4.html

の図9 と言うか表。

最左列は上から下に向かって微細になり右の3列は各社がEUV使った工程(レイヤー)数、

一番下の列をみれば最後までEUV使わず粘った米国マイクロン社も今は1~2層でEUV使っていて、新規参入の志那がEUV使わずメインストリームに踊り出る見込みは現実味 ほぼ無しなので(^-^;

尚この「EUV露光装置」はオランダASML社独占の1台300~500億円のトンでも装置で、

モチロンのアメリカ輸出規制のため志那は表では入手不可。

余りの高額装置のため裏密輸も困難

今の超解像技術は露光波長より大幅に小さい微細化も出来なくは無いので

波長193nmのArFエキシマ使って根性で7nmチップ量産した実績は志那にはあります。

が根性と表現した通り、波長13nmのEUVより確実に工程増でコストも増、

HBMは今 最先端ロジック並みの微細化が要求されつつコストはロジックより厳しく、

EUV使えない志那には まあ2~3年は厳しいでしょう。

– – – – –

さてウンチク教室

半導体IT業界の技術革新はドッグイヤーと言いまして成長進歩速度が非常識で

数年後にはEUVも古臭くなってる可能性もあり米国輸出規制も効果無しになってる「かも」なので1~2年先までしか予想してません(^-^;

HBMとは

1.私達コンシューマから見て①②

①姿:IC工場でGPUやCPUと同時パッケージされPCジサカーでも見ること無いでしょう。

②使ってる感:何かAI速い?実感乏しいでしょう。少なくともここ1~2年は

2.コンピュータメーカーから見て使うと技術的に何が美味しい?

GPUをAI専用ミニ・スパコン化出来る。

CPUは20コアもあれば高スペックだけどGPUは数千コアもある。その代わり各コアは単純なことしか出来ないしコア毎の割合メモリも少ない。

ここでちょっとコア性能上げて、ちょっと数千個コアのメモリを増やす…即ちHBM載せると…まるで数千台のコンピューターを並列結合させたスパコンのような(ただしAI専用、が比較的)安価に出来ます。

3.メモリーメーカーから見て

PCやスマホのメインメモリより数倍高額商品なのに需要目白押しのドル箱、だから次世代と呼ぶ?(笑)

– – – – –

HBMとは?とググったりChatGPTすると多様な使い方説明が出て来て

ウソとは言いきれないけど、

実質 今後1~3年分は、ほぼ売約済みで 用途はOpenAIがChatGPT動かしてるデータセンターとか、自動運転とか、ドローンAI兵器とか

に使える数で世界生産量アップアップですね(^-^;

こんなだし、コンシューマにはモノは見えないブラックボックスだし、

要するに暫くは

AI速くするGPU専用メモリーで我々にはアンマリ関係ないブツと考えれば大凡正確かと(^-^;

終わり

詳細に説明していただきありがとうございました。

お陰でより理解が深まりました。

ChatGPTさんも優秀ではあるんだけど、やっぱり詳しい方に聞いたほうが。